Mit MongoDB Atlas und LLMs zu Lösungen, die für Unternehmen geeignet sind

June 22, 2023 | Updated: March 18, 2025

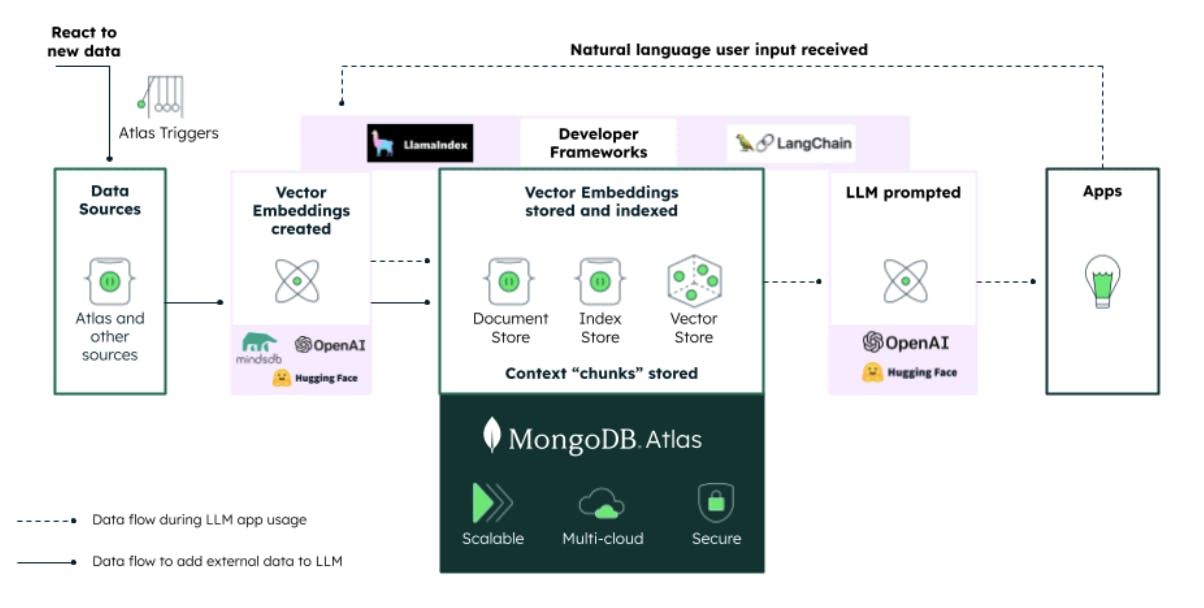

Wenn Sie mit generativen, mit KI unterstützten Anwendungen überzeugende, wirklich differenzierte Erlebnisse für Ihre Kunden schaffen wollen, muss die künstliche Intelligenz auf der Wahrheit beruhen. Diese Wahrheit basiert auf Ihren Daten, genauer gesagt, auf Ihren aktuellsten operativen Daten. Ganz gleich, ob Sie hyperpersonalisierte Erlebnisse mit der erweiterten semantischen Suche anbieten oder benutzergesteuerte Inhalte und Konversationen produzieren, MongoDB Atlas vereint operative, analytische und Vektorsuchdatendienste, um die Einbettung der Leistungsfähigkeit von LLMs und Transformer-Modellen in Ihre Anwendungen zu optimieren.

Jeden Tag erstellen Entwickler die nächste bahnbrechende, transformative, generative KI-gestützte Anwendung. Kommerzielle und Open-Source-LLMs entwickeln sich in rasantem Tempo. Es gibt zahlreiche Frameworks und Tools, mit denen man darauf aufbauen und Innovationen demokratisieren kann. Doch der Weg vom Prototyp zur Unternehmensreife dieser Anwendungen ist die Kluft, die Entwicklungsteams überwinden müssen. Erstens können diese großen Modelle falsche oder uninformierte Antworten liefern, weil die Daten, auf die sie Zugriff haben, veraltet sind. Es gibt zwei Möglichkeiten, uninformierte Antworten zu klären – die Feinabstimmung eines großen Modells oder die Bereitstellung eines Langzeitgedächtnisses. Dies bringt jedoch eine zweite Hürde mit sich – die Bereitstellung einer Anwendung um ein informiertes LLM herum mit den richtigen Sicherheitskontrollen und in dem Umfang und der Leistung, die die Benutzer erwarten.

Entwickler benötigen eine Datenplattform, die über die Flexibilität des Datenmodells verfügt, um sich an die sich ständig ändernden unstrukturierten und strukturierten Daten anzupassen, die in große Modelle einfließen, ohne durch starre Schemata behindert zu werden. Die Feinabstimmung eines Modells ist zwar eine Option, aber in Bezug auf Zeit und Rechenressourcen eine kostspielige Angelegenheit. Dies bedeutet, dass Entwickler in der Lage sein müssen, Daten im Rahmen von Eingabeaufforderungen als Kontext für große Modelle darzustellen. Sie müssen diesen generativen Modellen ein Langzeitgedächtnis geben. Im Folgenden finden Sie einige Beispiele dafür, wie dies mit verschiedenen LLMs und generativen KI-Frameworks erreicht werden kann.

Auf unserer KI-Ressourcenseite erfahren Sie mehr über die Entwicklung von KI-gestützten Apps mit MongoDB.

Fünf Ressourcen für die ersten Schritte mit MongoDB Atlas und Large Language Models

MongoDB Atlas ermöglicht die nahtlose Integration führender generativer KI-Services und -Systeme wie die Hyperscaler und Open Source LLMs und Frameworks. Durch die Kombination von Dokumenten- und Vektoreinbettungsdatenspeichern an einem Ort über Atlas Database und Atlas Vector Search (Vorschau) können Entwickler die Erstellung ihrer generativen, mit KI angereicherten Anwendungen beschleunigen, die auf den tatsächlichen Betriebsdaten beruhen. Im Folgenden finden Sie Beispiele für die Arbeit mit gängigen LLM-Frameworks und MongoDB:

1. Starten Sie mit Atlas Vector Search (Vorschau) und OpenAI für die semantische Suche

Dieses Tutorial führt Sie durch die Schritte der semantischen Suche in einem Beispiel-Filmdatensatz mit MongoDB Atlas. Zunächst richten Sie einen Atlas-Trigger ein, der eine OpenAI-API aufruft, sobald ein neues Dokument in Ihren Cluster eingefügt wird, um es in eine Vektoreinbettung umzuwandeln. Dann führen Sie eine Vektorsuchanfrage mit Atlas Vector Search durch. Es gibt sogar einen speziellen Bonusbereich für die Nutzung von HuggingFace-Modellen. Lesen Sie das Tutorial.

2. Erstellen Sie mit Llamalndex und MongoDB eine mit KI angereicherte Chat-App mit Ihren eigenen Daten

LlamaIndex bietet eine einfache, flexible Schnittstelle, um LLMs mit externen Daten zu verbinden. In diesem gemeinsamen Blog von LlamaIndex und MongoDB erfahren Sie mehr darüber, warum Sie Ihre eigene Chat-App erstellen sollten und wie. Das beigefügte Notizbuch im Blog enthält eine Code-Anleitung, wie Sie jedes PDF-Dokument mit englischsprachigen Abfragen abrufen können. Lesen Sie den Blog.

3. In der Dokumentation erfahren Sie, wie Sie Atlas Vector Search (Vorschau) als Vektorspeicher mit LangChain verwenden können

Wie im Blogbeitrag zur Ankündigung der Partnerschaft erwähnt, passen LangChain und MongoDB Atlas auf natürliche Weise zusammen. Das hat die Begeisterung der Community gezeigt, die zu mehreren Integrationen in LangChain für MongoDB geführt hat. Zusätzlich zur Unterstützung von Atlas Vector Search als Vektorspeicher gibt es bereits Unterstützung für die Nutzung von MongoDB als Chat-Protokollverlauf. Lesen Sie die Dokumentation: Python, JavaScript.

4. Generieren Sie Vorhersagen direkt in MongoDB Atlas mit MindsDB AI Collections

MindsDB ist eine Open-Source-Plattform für maschinelles Lernen, die automatisiertes maschinelles Lernen in die Datenbank bringt. In diesem Blog erfahren Sie, wie Sie mit MindsDB AI Collections direkt in Atlas Vorhersagen generieren können. Damit haben Sie die Möglichkeit, Vorhersagen als reguläre Daten zu nutzen, diese Vorhersagen abzufragen und die Entwicklungsgeschwindigkeit durch Vereinfachung der Bereitstellungsabläufe zu erhöhen. Lesen Sie den Blog.

5. Integrieren Sie HuggingFace-Transformatormodelle in MongoDB Atlas mit Atlas Triggers

HuggingFace ist eine KI-Community, die es einfach macht, Modelle für maschinelles Lernen zu erstellen, zu trainieren und einzusetzen. Durch den Einsatz von Atlas Triggers in Verbindung mit HuggingFace können Sie problemlos auf Änderungen der Betriebsdaten reagieren, die Ihren Modellen ein Langzeitgedächtnis verleihen. Lernen Sie, wie Sie Trigger einrichten, um automatisch die Stimmung neuer Dokumente in Ihrer MongoDB-Datenbank vorherzusagen und sie als zusätzliche Felder zu Ihren Dokumenten hinzuzufügen. Sehen Sie sich das GitHub-Repository an.

Vom Prototyp zur Produktion mit MongoDB für mit generativer KI erweiterte Anwendungen

Die auf Atlas aufbauende moderne Datenbank von MongoDB bietet ein modernes, optimiertes Entwicklererlebnis und wurde von Tausenden von Unternehmen auf der ganzen Welt im Hinblick auf Skalierbarkeit und Sicherheit getestet.

Ganz gleich, ob Sie in einem Startup oder in einem Unternehmen das nächste große Ding entwickeln, Atlas ermöglicht Ihnen:

-

Beschleunigung der Entwicklung Ihrer mit generativer KI erweiterten Anwendungen, die auf tatsächlichen Betriebsdaten beruhen.

-

Vereinfachung Ihrer App-Architektur durch Nutzung einer zentralen Plattform, die es ihnen ermöglicht, App- und Vektordaten am selben Ort zu speichern, mit serverlosen Funktionen auf Änderungen in den Quelldaten zu reagieren und über mehrere Datenmodalitäten hinweg zu suchen, um die Relevanz und Genauigkeit der von ihren Apps generierten Antworten zu verbessern.

-

Weiterentwickelung Ihrer mit KI erweiterten Apps mit der Flexibilität des Dokumentenmodells unter Beibehaltung einer einfachen, eleganten Entwicklererfahrung.

-

Nahtlose Integration führender KI-Services und -Systeme wie die Hyperscaler und Open Source LLMs und Frameworks, um in dynamischen Märkten wettbewerbsfähig zu bleiben.

-

Entwicklung von mit KI erweiterten Anwendungen auf einer leistungsstarken, hoch skalierbaren operativen Datenbank, die seit einem Jahrzehnt für eine Vielzahl von KI-Anwendungsfällen validiert wurde.

Während diese Beispiele die Bausteine für etwas Innovativeres sind, kann MongoDB Ihnen helfen, vom Konzept zur Produktion zu gelangen und zu skalieren. Legen Sie noch heute los, indem Sie sich für das kostenlose MongoDB Atlas-Angebot anmelden und die Integration mit Ihren bevorzugten Frameworks und LLMs vornehmen. Wenn Sie daran interessiert sind, enger mit uns zusammenzuarbeiten, werfen Sie einen Blick auf unser MongoDB AI Innovators-Programm, das Innovationen im Bereich der künstlichen Intelligenz fördert und innovative Lösungen von Startups, Kunden und Partnern präsentiert.